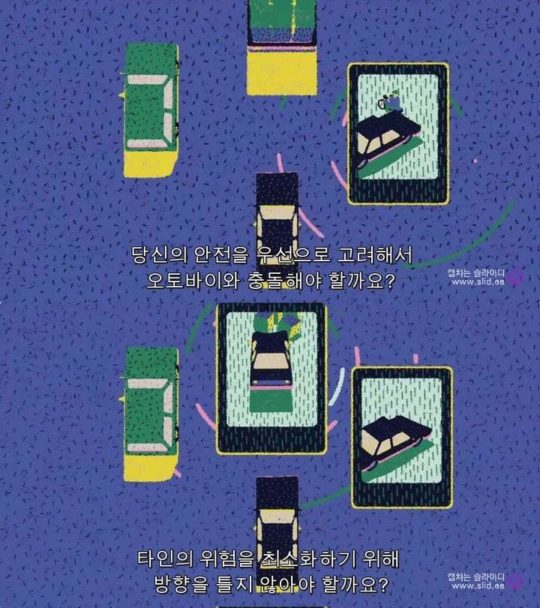

요즘은 인공지능에 대한 관심이 어느 때 보다도 높은 것 같습니다. 특히 자율주행 자동차가 화두가 되면서 아래와 같은 질문이 인공지능에게 던져졌습니다.

“당신의 안전을 우선시할 것인가? 아니면 사고가 나는 것이 확실한 상황에서 SUV 혹은 오토바이를 선택할 것인가?”

사실 이 문제는 마이클 샌델 교수의 <Justice> 명강의에서 많이 봤던 문제입니다. 이에 대한 논의는 첨예합니다. 이는 인공지능을 반대하는 논리로도 쓰이곤 하죠. 하지만 저는 이게 지적 유희로는 즐거운 주제일지 몰라도, 실제 인공지능 특히 자율주행 개발에 대해서는 그다지 의미 없는 논의라고 봅니다.

인공지능에게 학습시키는 미션 중 ‘윤리’가 있는가?

먼저 이 논의에 접근하는 방식을 생각해 봅시다. 프로그램은 프로그래머에 의해 설계된 대로 행동한다는 가정을 가지고 있습니다. 모든 상황과 경우의 수를 프로그래머가 완벽히 통제하고 있다는 가정입니다.

그런데 개발자(였던)로서 한 마디 던지자면, “천만에요.”라고 말씀드리고 싶습니다. 프로그래머가 개발한 프로그램은 사전에 정의한 것 이외의 처리는 ‘프로그래머도 잘 모르겠다’가 됩니다. 까봐야 알거나, 케이스 바이 케이스입니다. 가능한 그런 입력데이터는 들어오지 않기를 바라거나 그냥 무시(예외처리)해 버리죠. 내부적으로 무슨 문제가 벌어질지 모르는데 그런 질문을 컴퓨터에게 던져봐야 좋을 게 없습니다.

그런데 만약 인공지능이라면 어떨까요? 그럼 먼저 인공지능을 개발하는 방법부터 이해해야 합니다. 인공지능은 사람들의 습관을 모방하는 기계입니다. 그중 몇 가지 방향성만이 주어지죠. 자율주행 차에게 학습시키는 미션은 단순합니다.

- 우선 목적지까지 이동할 것

- 가능한 빠른 속도로 사고 나지 않게 운전할 것

끝입니다. 더 이상 없습니다. 우선 목적지까지 이동하는 건 도로를 타고 달리는 기능이니 일단 본 사고의 위협에 대해서는 논의를 제외하겠습니다. 물론 도로별로 사고확률과 이동시간은 가중치에 따라 결정될 텐데, 이는 경로 설정 외에는 그다지 도움되지 않을 겁니다. 그냥 네비게이션이죠.

중요한 건 2번인데, 여기에서 ‘사고상황’ 이란건 이미 예외 케이스입니다. 인공지능의 목표는 딱 하나입니다. 빠른 속도와 사고 나지 않게 운전하는 방법을 찾는 거죠. 이는 그동안 인간의 많은 주행 습관과 당시의 상황 정보를 가지고 학습합니다. 혹은 아주 단순하게 룰 기반으로도 가능하겠죠.

후자의 경우에는 인공지능이라기보다는 그냥 프로그램으로 앞에서 말한 ‘정의’를 코드로 넣는 게 가능합니다. 하지만, 일반적으로 요즘 논의되는 인공지능 운전자는 전자입니다. 거기에는 주행습관과 상황 정보를 기반으로 만들어진 어떤 운전모델만이 존재합니다.

SUV와 오토바이는 ‘큰 당구공’과 ‘작은 당구공’일 뿐이다

앞의 질문을 보면 말이 안 되는 것 중 하나가 오토바이든 SUV던 100% 쳐야 되는 상황을 가정합니다. 그러나 이런 인공지능 프로그램에게 양자택일로 100% 사고 나는 상황은 거의 존재하지 않습니다. 분명 좌나 우를 선택하는 시점에는 SUV가 피할 확률과 오토바이가 피할 확률이 동시에 계산되고, 그 확률이 1%라도 낮은 쪽으로 움직일 겁니다. 그게 SUV일지 오토바이일지는 모릅니다. 단순히 저건 A란 물체이며 어떤 크기를 가지고 속도와 방향으로 움직이고 있고, B란 물체도 그런 식의 정보만을 파악하고 있죠.

인공지능 자동차에게는 SUV와 오토바이는 큰 당구공과 작은 당구공일 뿐입니다. 따라서 실제 인공지능 자동차가 100% 충돌이라고 인지하는 순간은 이미 A든 B든 결정된 상황일 가능성이 높겠죠.

그 다음 상상할 수 있는 더 끔찍한 가정은, 사고처리에 대한 비용을 가중치로 넣는다는 상상입니다. 그런 데이터는 수집하기도 어렵거니와 인공지능 머신에 넣으려면 훈련데이터가 더 얼마나 복잡해질지 상상도 가지 않습니다. 일반적으로 훈련데이터가 복잡해지면 성능도 함께 하락합니다. 자동차와 같은 Realtime embeded SW에서는 절대 해서는 안 되는 짓 중에 하나입니다. 인공지능이라해도 해당 SW의 본질은 변하지 않으며, 설사 만약 넣는것이 문제라면 훈련데이터로 무엇을 사용하는지를 공개하거나 감시하는 제도를 만들면 해결되리라고 봅니다.

그리고, 법적 논의는 사실 이미 개인정보보호법 등의 사례를 통해 충분히 봐 왔습니다. 특히 기술 문제는요. 설계자가 법이 정한 사상을 얼마나 충실히 지켰는지 전문가에 의해서 그 정도를 판단하여 사고에 대한 책임의 범위를 지게 하는 ‘개발자 윤리’ 쪽 접근이 기본 원리입니다. 인공지능이라고 이게 크게 달라지지는 않을 거라고 봅니다.

현재 조금 개선된 ADAS가 대부분 국내 기술 수준이고, 자율주행 4단계까지 이르러도 저 정의를 생각할 인공지능 수준이면… 5단계라고 불러도 될 겁니다. 임베디드SW가 저 수준에 올랐을 때는 클라우드 기반의 인공지능은 초지능 수준에 도달했을 테니 그냥 그 친구한테 맡기죠.

마무리하며

지적 유희는 즐겁지만, 너무 진지해져서 신기술의 발전을 틀어막지 않았으면 합니다. 걸음마를 걷기 시작한 아이를 보면서 동네 애들 때릴 걱정부터 하지는 않았으면 하네요. 인공지능은 인류를 뛰어넘을 수도 인류를 위협할 수도 있겠지만, 인간은 아닙니다. 따라서 인간과 동일한 기준으로 접근해서는 제대로 된 대응이 나오기 어렵다고 생각합니다.

원문: 숲속얘기의 조용한 카페